Wat zijn Crawlers?

Crawlers, ook bekend als spiders, bots of webcrawlers, zijn automatische programma's die door zoekmachines worden gebruikt om het internet systematisch te verkennen en te indexeren. Ze scannen webpagina's, verzamelen er gegevens van, en sturen deze informatie terug naar de zoekmachine om een gedetailleerde index op te bouwen. Deze index wordt gebruikt om zoekvragen van gebruikers efficiënt te beantwoorden.

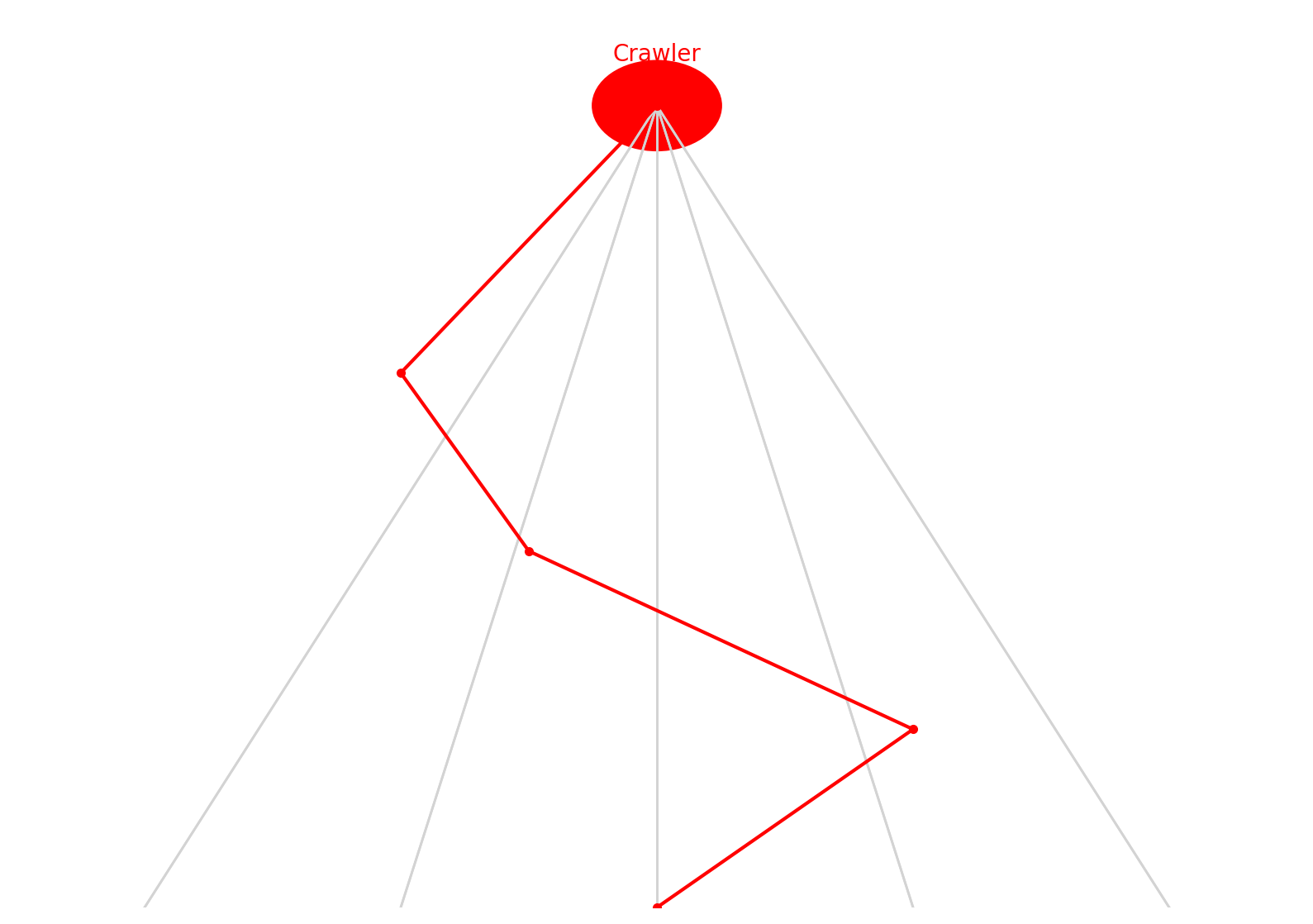

Hoe Werken Crawlers?

- Startpunt: Crawlers beginnen hun zoektocht vanaf een set van vooraf bepaalde webpagina's.

- Informatieverzameling: Ze lezen de inhoud van deze pagina's en volgen alle links, zowel intern (binnen dezelfde site) als extern (naar andere websites).

- Indexering: Terwijl ze door de links navigeren, verzamelen ze informatie over nieuwe pagina's die ze ontdekken en voegen deze toe aan de zoekmachine-index.

Synoniemen voor Crawlers:

- Spiders: Een term die het web-achtige proces van het verkennen en indexeren van het internet benadrukt.

- Bots: Een verkorte vorm van robots, verwijzend naar de geautomatiseerde aard van deze programma's.

- Webcrawlers: Een specifieke benaming die het doel van deze bots benadrukt, namelijk het crawlen van het web.

- Web Spiders: Een variatie op spiders, met dezelfde implicatie van het verkennen van het web.

- Web Robots: Een andere term die de geautomatiseerde functie van deze programma's benadrukt.

- Search Engine Bots: Specificeert dat deze robots specifiek voor zoekmachines werken om data te verzamelen.

Belang van Crawlers:

Deze automatische programma's zijn cruciaal voor het functioneren van zoekmachines. Ze helpen bij het ordenen van de enorme hoeveelheid informatie op het internet, waardoor deze toegankelijk wordt voor gebruikers via zoekopdrachten.